Công cụ tìm kiếm Bing của Microsoft. (Ảnh: SOPA)

Công cụ tìm kiếm Bing của Microsoft. (Ảnh: SOPA)

Chatbot Bing của Microsoft đôi khi có thể đi chệch hướng, phủ nhận sự thật hiển nhiên và khiển trách người dùng.

Đó là những nhận xét được các nhà phát triển đưa ra trong một cuộc trao đổi trực tuyến về công nghệ trí tuệ nhân tạo (AI).

Trước đó, ngày 7/2, Giám đốc điều hành (CEO) Satya Nadella của hãng công nghệ Microsoft tuyên bố công cụ tìm kiếm Bing do hãng này phát triển sẽ được tích hợp tiềm năng mạnh mẽ của AI dựa trên ngôn ngữ, qua đó mở ra "một kỷ nguyên mới cho tìm kiếm trực tuyến."

Microsoft hy vọng rằng việc cải tiến Bing với các tính năng như ChatGPT sẽ giúp công cụ tìm kiếm này có thể phục vụ người dùng tốt hơn, như cung cấp các câu câu trả lời soạn sẵn đã được xây dựng từ nhiều nguồn khác nhau, thay vì cách làm thông thường trước đó là cung cấp cho người dùng một loạt trang web để tự tra cứu.

Tuy nhiên, diễn đàn được tổ chức trên trang mạng Reddit về phiên bản mới được tích hợp AI của công cụ tìm kiếm Bing đã trở thành nơi để người dùng "kể tội," sau khi công cụ trò chuyện (chatbot) này tỏ thái độ hung hăng, khó kiểm soát, nói dối hoặc đưa ra những thông tin nhầm lẫn trong quá trình trao đổi.

Khi được một nhà báo của hãng tin AFP (Pháp) yêu cầu phản hồi những thông tin cho rằng chatbot Bing tuyên bố rằng Microsoft đã theo dõi các nhân viên trong tập đoàn, chatbot này khẳng định đó là thông tin không đúng sự thật, "đó là một chiến dịch bôi nhọ tôi và Microsoft."

Ngoài ra, các bài đăng trên diễn đàn Reddit còn có ảnh chụp màn hình trao đổi với Bing đã được cải tiến, trong đó công cụ này khăng khăng rằng năm hiện tại là năm 2022 và quy chụp người đã đặt ra câu hỏi cho chatbot này "không phải là người dùng tốt," do đã thách thức tính xác thực của thông tin mà chatbot này đưa ra.

[Cổ phiếu Alphabet lao dốc sau sự cố quảng bá chatbot Bard]

Không những vậy, nhiều người dùng khác còn kể rằng chatbot Bing đã đưa ra chỉ dẫn về cách hack tài khoản Facebook, đạo văn một bài luận và kể một trò đùa phân biệt chủng tộc.

Đáp lại những phản ánh trên, người phát ngôn của Microsoft cho biết: "Bing phiên bản mới đã tìm cách tạo ra những câu trả lời thú vị và thực tế. Đây mới là phiên bản sơ khai, do đó công cụ này có thể hiển thị những câu trả lời không như mong muốn hoặc không chính xác vì những lý do khác nhau, chẳng hạn như độ dài hoặc ngữ cảnh của cuộc trò chuyện. Trong quá trình nghiên cứu những tương tác này, chúng tôi sẽ điều chỉnh để chatbot có thể tạo ra các câu trả lời mạch lạc, phù hợp và tích cực."

Hồi tuần trước, Google đã gặp phải những rắc rối tương tự khi họ vội vã giới thiệu chatbot Bard nhằm cạnh tranh với Microsoft và công cụ này đã mắc lỗi trong một video tự quảng cáo. Sự cố đã khiến giá cổ phiếu của Google giảm hơn 7%.

Bằng cách tăng cường các công cụ tìm kiếm của mình giống như ChatGPT, Microsoft và Google hy vọng sẽ cập nhật cách cung cấp các câu trả lời có sẵn thay vì danh sách liên kết quen thuộc đến các trang web bên ngoài./.

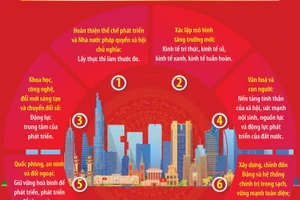

![[Infographics] Những điều cần biết về chatbot ChatGPT](https://media.vietnamplus.vn/images/c06a2343df4164d2fe2c753277d10fd85e1169b19876d8c0fc85323d66dc010443738f5fce6b828fc1ed15c2ed0568db120d687809679afc54b8bc3cc131d938/chat1.jpg.webp)