Tại cuộc họp báo thường kỳ tháng 9 của Bộ Khoa học và Công nghệ diễn ra vào sáng 26/9, ông Hồ Đức Thắng - Viện trưởng Viện Công nghệ số và Chuyển đổi số Quốc gia (Bộ Khoa học và Công nghệ) đã có những chia sẻ về việc nghiên cứu đưa trí tuệ nhân tạo vào bậc tiểu học.

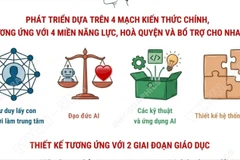

Theo ông Thắng, AI coi là hoạt động hết sức chiến lược, nhiệm vụ quan trọng toàn dân và toàn diện. Khi đưa vào tiểu học cần đặt mục tiêu không thể kỳ vọng các em là "kỹ sư nhí" được, mà cần phải tạo ra hàng rào bảo vệ cho các em, AI đưa vào hệ thống giáo dục tiểu học có rủi ro cao, cần danh mục rõ ràng trước khi đưa vào giảng dạy, đảm bảo vấn đề đạo đức ở mức cao nhất.

Ông Hồ Đức Thắng nhấn mạnh, thay vì tập trung cho các em học sinh sử dụng AI thì nên tập trung hỗ trợ các thầy cô trước trong các bài giảng trở nên gần gũi hơn.

Ông Thắng cũng đưa ra ví dụ thực tế trên thế giới như Singapore triển khai các module ngắn, giúp học sinh hiểu khái niệm AI an toàn và có trách nhiệm; Estonia tập trung vào giáo viên; Hàn Quốc từng thay sách giáo khoa quá sớm bằng ứng dụng số nhưng đôi khi chưa thực sự hiệu quả.

Cùng với đó việc thực hiện triển khai AI cũng cần đảm bảo hạ tầng tránh việc bất bình đẳng, ví dụ như trẻ em ở thành phố sử dụng được, nhưng vùng sâu vùng xa không có điều kiện tiếp cận.

"Tổng kết lại, đưa AI vào tiểu học cần thiết, nhưng phải có chọn lọc, mục tiêu rõ ràng và phải thí điểm trước," ông Hồ Đức Thắng khẳng định.

Trước đó, tại Hội thảo “Sức mạnh không giới hạn và những thách thức khó dự báo của trí tuệ nhân tạo (AI) - Tác động và ứng phó chính sách," ông Trương Gia Bình - Chủ tịch FPT cho rằng: "Nếu trẻ em Việt Nam từ lớp 1 đã học cùng AI, làm việc với AI và lớn lên cùng AI, đến khi trưởng thành, có thể thích nghi bất kể tương lai thay đổi thế nào bởi tác động của AI. Quan trọng nhất là dạy, học và đánh giá bằng AI và phải làm nhanh nhất có thể."

Cũng trong khuôn khổ cuộc họp báo, đại diện Viện Công nghệ số và Chuyển đổi số Quốc gia cũng chia sẻ về phòng chống rủi ro về an ninh mạng liên quan đến việc ứng dụng AI. Theo đó, tại Việt Nam đang nghiên cứu xây dựng Luật AI, trên thế giới chưa nhiều quốc gia ban hành luật AI.

Ông Thắng phân tích: “AI là công cụ tốt nhưng có 2 mặt, mặt rủi ro không chỉ liên quan đến việc an ninh mạng mà còn liên quan đến đạo đức, thiên kiến và bất bình đẳng… hiện nay các luật AI đều cố gắng quản lý AI cần phân loại mức độ rủi ro. Quản lý rủi ro về AI gồm 3 lớp, lớp đầu tiên là phân loại AI ở mức độ rủi ro, AI mang tính rủi ro cao như dịch vụ công, y tế, giáo dục ưu tiên phân loại, ngay từ khâu thiết kế, vận hành cần đảm bảo các vấn đề dữ liệu sạch, đảm bảo vấn đề đạo đức, không thiên kiến và đảm bảo quyền lợi của con người. Quá trình vận hành mô hình AI cũng cần đi kèm hoạt động giám sát kỹ thuật và cần có tiêu chuẩn kỹ thuật cho cả hệ thống."

Đại diện Viện Công nghệ số và Chuyển đổi số Quốc gia đưa ra ví dụ về video sử dụng công nghệ Deepface, nếu không có yêu cầu từ nhà nước cần phải gắn nhãn do AI tạo ra, cần minh bạch. Đây là một yêu cầu cần phải có.

Cuối cùng cần chế tài xử phạt nghiêm khắc, như châu Âu có những hình phạt rất nặng, lên tới 35 triệu Euro hoặc 7% doanh thu trên toàn cầu. Đây là hình thức răn đe mạnh tay cho các người dùng hay tội phạm sử dụng AI vào mục đích xấu./.

Liên hợp quốc: Lời kêu gọi về "lằn ranh đỏ" toàn cầu đối với trí tuệ nhân tạo

Ngày 22/9, các nhà lập pháp châu Âu cùng những người đoạt giải Nobel và các nhà nghiên cứu hàng đầu về AI đã kêu gọi đưa ra các quy tắc quốc tế ràng buộc để chống lại các ứng dụng nguy hiểm của AI.