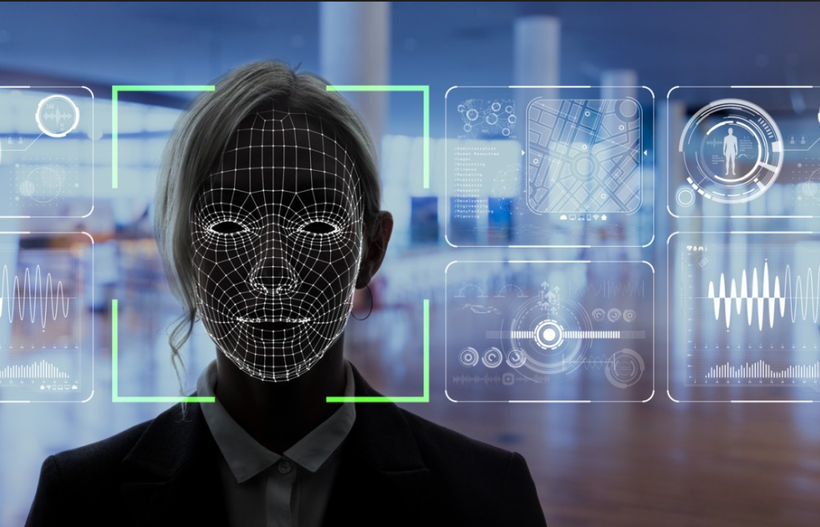

Theo phóng viên TTXVN tại Brussels, một nghiên cứu mới đây của các nhà khoa học thuộc KU Leuven (Bỉ) đã làm dấy lên quan ngại về hiệu quả của hệ thống phát hiện hình ảnh lạm dụng trẻ em (CSAM) PhotoDNA.

Đây là công cụ hiện được nhiều nền tảng công nghệ lớn như Google, Facebook, Instagram hay TikTok sử dụng để phát hiện và ngăn chặn nội dung xâm hại trẻ em trên môi trường mạng.

Theo nhóm nghiên cứu, đây là lần đầu tiên cơ chế hoạt động của công nghệ PhotoDNA, do Microsoft phát triển từ năm 2009, đã được phân tích và tái dựng thành công.

Cụ thể, việc phát hiện CSAM chủ yếu dựa trên cơ chế so sánh hình ảnh do người dùng đăng tải với cơ sở dữ liệu tập trung của Trung tâm quốc gia về Trẻ em mất tích và bị lạm dụng (NCMEC) tại Mỹ.

Kho dữ liệu này lưu trữ hàng trăm triệu hình ảnh đã được xác định là liên quan đến lạm dụng trẻ em. Khi phát hiện trùng khớp, hệ thống có thể tự động khóa tài khoản và chuyển thông tin cho cơ quan chức năng.

Tuy nhiên, kết quả nghiên cứu cho thấy hệ thống này tồn tại những điểm yếu đáng kể. Các nhà khoa học chứng minh rằng chỉ với những chỉnh sửa rất nhỏ, hình ảnh vi phạm có thể dễ dàng vượt qua cơ chế kiểm duyệt.

Ngược lại, công nghệ cũng có thể bị lợi dụng để khiến các hình ảnh bình thường bị nhận diện nhầm là nội dung vi phạm.

Ngoài ra, để nâng cao hiệu quả, PhotoDNA sử dụng phương pháp tạo “chữ ký số” cho từng hình ảnh, cho phép nhận diện ngay cả khi nội dung đã bị chỉnh sửa.

Tuy nhiên, nhóm nghiên cứu cũng chỉ ra nguy cơ rò rỉ thông tin từ các "chữ ký số" này, làm dấy lên lo ngại về việc lộ dữ liệu liên quan đến nạn nhân.

Theo báo cáo minh bạch của Meta, tỷ lệ nhận diện nhầm hiện dao động từ 0,1% đến 0,3%. Tuy nhiên, với hàng tỷ hình ảnh được xử lý mỗi ngày, tỷ lệ này có thể ảnh hưởng tới một số lượng lớn người dùng.

Những phát hiện từ KU Leuven có ý nghĩa quan trọng trong bối cảnh các công nghệ quét nội dung đang được đề xuất mở rộng, bao gồm cả việc kiểm tra tin nhắn riêng tư và thiết bị cá nhân tại châu Âu.

Nếu không được hoàn thiện, các hệ thống này có thể tiềm ẩn nguy cơ bị lạm dụng, ảnh hưởng đến quyền riêng tư và dẫn tới các trường hợp xử lý oan sai.

Nhóm nghiên cứu nhấn mạnh cần tăng cường tính minh bạch, khả năng kiểm chứng và độ an toàn của các công nghệ phát hiện CSAM, nhằm bảo đảm hiệu quả trong bảo vệ trẻ em, đồng thời hạn chế tối đa tác động tiêu cực đối với người dùng./.

Nhật Bản: 50% vụ deepfake khiêu dâm trẻ vị thành niên do bạn học gây ra

Cảnh sát xác định ít nhất 18% vụ việc có sử dụng trực tiếp công cụ AI tạo sinh; 80% các vụ việc còn lại không thể xác định phương thức mà thủ phạm sử dụng nhưng nhiều khả năng có sự can thiệp từ AI.